Информации - это что такое? На чем он базируется? Какие цели преследует и задачи выполняет? Обо всём этом мы и поговорим в рамках данной статьи.

Общая информация

В каких случаях применяется семантический способ измерения информации? Используется сущность информации, интересует содержательная сторона полученного сообщения - вот показания для его применения. Но для начала давайте дадим изъяснение того, что он собой представляет. Следует отметить, что семантический способ измерения информации - это трудно формализованный подход, который до сих пор полностью не сформировался. Используется он для того, чтобы измерять количество смысла в данных, которые были получены. Иными словами, какой объем информации из полученной является необходимым в данном случае. Такой подход используется для определения содержательной стороны получаемых сведений. И если мы говорим про семантический способ измерения информации, используется понятие тезауруса, которое неразрывно связано с рассматриваемой темой. Что же оно собой представляет?

Тезаурус

Хочется сделать небольшое введение и дать ответ на один вопрос про семантический способ измерения информации. Кем введен он? Предложил использовать этот метод основатель кибернетики Норберт Винер, но значительное развитие он получил под влиянием нашего соотечественника А. Ю. Шрейдера. Чем же является название используется для обозначения совокупности сведений, которые есть у получателя информации. Если соотнести тезаурус с содержанием сообщения, которое поступило, то можно выяснить, насколько оно снизило неопределённость. Хочется исправить одну ошибку, под влияние которой часто попадает большое количество людей. Так, они считают, что семантический способ измерения информации введен Клодом Шенноном. Неизвестно, как именно возникло это заблуждение, но это мнение неверно. Клод Шеннон ввёл статистический способ измерения информации, «наследником» которого и считается семантический.

Графический подход для определения объема смысловой информации в полученном сообщении

Для чего нужно что-то рисовать? Семантический способ измерения использует такую возможность для наглядного предоставления данных о полезности данных в виде легко понимаемых рисунков. Что же это значит на практике? Для пояснения положения дел строят зависимость в виде графика. Если у пользователя отсутствуют знания о сути сообщения, которое было получено (равняется нулю), то объем семантической информации будет равен этому же значению. Можно ли найти оптимальное значение? Да! Так называется тезаурус, где объем семантической информации максимальный. Давайте рассмотрим небольшой пример. Допустим, пользователю поступило сообщение, написанное на незнакомом иностранном языке, или же человек может прочитать, что там написано, но это для него уже не является новостью, поскольку всё это известно. В таких случаях говорят о том, что в сообщении содержится ноль семантической информации.

Историческое развитие

Вероятно, об этом следовало поговорить немного выше, но наверстать упущенное ещё не поздно. Первоначально семантический способ измерения информации введен Ральфом Хартли в 1928 году. Ранее упоминалось, что в качестве основателя часто упоминают Клода Шеннона. Почему же возникла такая путаница? Дело в том, что, хотя семантический способ измерения информации и был введён Ральфом Хартли в 1928 году, обобщили его в 1948 году именно Клод Шеннон и Уоррен Уивер. После этого основоположник кибернетики Норберт Винер сформировал идею тезаурусного метода, которая получила наибольшее признание в виде меры, разработанной Ю. И. Шнейдером. Следует отметить, что для того чтобы разобраться в этом, необходим достаточно высокий уровень знаний.

Результативность

Что же нам даёт тезаурусный метод на практике? Он является реальным подтверждением тезиса о том, что информация обладает таким свойством, как относительность. При этом следует отметить, что она обладает относительной (или же субъективной) ценностью. Для того чтобы можно было объективно оценивать научную информацию, ввели понятие общечеловеческого тезауруса. Его степень изменения и показывает значительность знаний, которые получает человечество. При этом нельзя точно сказать, какой конечный результат (или же промежуточный) можно будет получить от информации. Возьмём, к примеру, компьютеры. Вычислительная техника создавалась на основе ламповой технологии и битового состояния каждого структурного элемента и первоначально использовалась для осуществления расчетов. Сейчас же почти у каждого человека есть что-то, что работает на основании данной технологии: радио, телефон, компьютер, телевизор, ноутбук. Даже современные холодильники, плиты и умывальники содержат в себе немного электроники, в основе работы которой лежит информация об облегчении использования человеком данных бытовых устройств.

Научный подход

Где же изучается семантический способ измерения информации? Информатика - вот та наука, которая занимается различными аспектами этого вопроса. В чём же заключается особенность? В основу способа положено использование системы «истина/ложь», или же битовая система «единица/ноль». Когда поступает определённая информация, то она разбивается на отдельные блоки, которые именуются подобно единицам речи: слова, слоги и тому подобное. Каждый блок получает определённое значение. Давайте рассмотрим небольшой пример. Рядом стоят два друга. Один обращается ко второму со словами: «Завтра у нас выходной». Когда дни для отдыха - знает каждый. Поэтому ценность этой информации нулевая. Но если второй скажет, что он завтра работает, то для первого это будет неожиданность. Ведь в таком случае может оказаться, что будут нарушены планы, которые строил один человек, например, сходить поиграть в боулинг или же покопаться в мастерской. Каждую часть описанного примера можно описать с помощью единиц и нулей.

Оперирование понятиями

Но что же используется ещё, кроме тезауруса? Что ещё нужно знать, чтобы понимать семантический способ измерения информации? Основные понятия, которые дополнительно можно изучить ещё, - это знаковые системы. Под ними понимают средства выражения смысла, вроде правил интерпретации знаков или же их сочетаний. Давайте рассмотрим ещё один пример из информатики. Компьютеры оперируют условными нулями и единицами. По сути, это низкое и высокое напряжение, которое подаётся на компоненты техники. Причем передают они эти единицы и нули без конца и края. Как же делать различие между ними технике? Ответ на это был найден - прерывания. Когда передаётся эта же самая информация, то получаются различные блоки вроде слов, словосочетаний и отдельных значений. В устной человеческой речи для разбивки данных на отдельные блоки тоже используются паузы. Они настолько незаметны, что большинство из них мы замечаем на «автомате». В письме для этой цели служат точки и запятые.

Особенности

Давайте затронем ещё и тему свойств, которые есть у семантического способа измерения информации. Мы уже знаем, что так называется специальный подход, которые оценивает важность информации. Можно ли говорить, что данные, которые будут оцениваться таким способом, будут объективными? Нет, это не верно. Информация является субъективной. Давайте рассмотрим это на примере школы. Есть отличник, который идёт впереди утверждённой программы, и среднестатистический середнячок, который изучает то, что излагается на занятиях. Для первого большинство информации, которую он будет получать в школе, будет представлять достаточно слабый интерес, поскольку он это уже знает и не впервые слышит/читает. Поэтому на субъективном уровне для него это будет не очень ценно (за счёт разве что отдельных замечаний учителя, которые он подметил за время изложения своего предмета). Тогда как середнячок о новой информации что-то слыхал только отдаленно, поэтому для него ценность данных, которые будут излагаться на уроках, на порядок больше.

Заключение

Следует отметить, что в информатике семантический способ измерений информации - это не единственный вариант, в рамках которого можно решать имеющиеся задачи. Выбор должен зависеть от поставленных целей и присутствующих возможностей. Поэтому, если тема заинтересовала или же в ней существует потребность, то можно только настоятельно порекомендовать изучить её более подробно и узнать, какие ещё способы измерения информации, кроме семантического, существуют.

Семантические теории информации

Ограниченность математических теорий информации заключается в том, что они полностью абстрагируются от осмысленности и ценности информации для потребителя, учитывая только количественный аспект. В математических теориях понятие информации не связано ни с формой, ни с содержанием сигналов, передаваемых по каналу связи. Информация, точнее количество информации, есть абстрактная фикция, умственный конструкт; она не существует в физической реальности. Получается, что «совокупность из 100 букв, выбранных случайным образом, отрывок текста длиной в 100 букв из периодического печатного издания и аналогичной длины отрывок из художественного произведения или научной теоремы содержат в точности одинаковое количество информации». Поэтому зачастую понятие информации связывают с другим понятием - знание.

Л.А. Микешиной и М.Ю. Опенковым предпринята следующая попытка сравнить знание и информации: «можно сравнить передачу знания через информацию с передачей музыки через нотную запись. Композитор создает музыку, но пишет ноты. Подлинный исполнитель читает ноты, но воссоздает музыку». Информация в противоположность знанию не связана с конкретной личностью, она равно доступна всем, хотя возможности превратить ее в знание у каждого свои, опирающиеся на личный опыт и способности. Таким образом, различие между знанием и информацией Л.А. Микешина и М.Ю. Опенков выражают формулой: информация - это знание минус человек; то есть информация - знаковая оболочка знания.

Р. Карнап и Бар-Хиллел одними из первых сделали попытку раскрыть семантический аспект информации. Содержание информации у них определяется как некоторые факты, подтверждающие индуктивную гипотезу. Степень подтверждения гипотезы равна количеству семантической информации, содержащемуся в гипотезе относительного достоверному знанию (эмпирическим данным). Однако их работы подверглись критике за бедность получающегося языка (они использовали язык логики одноместных предикатов первого порядка), а также за абсолютизирование вероятностных представлений.

Другая попытка построения теории информации была предпринята Ю. Шрейдером, который предложил количественно оценивать смысловое значение знаков при помощи тезауруса. Количество семантической информации сообщения он предлагал измерять степенью изменения тезауруса после получения этого сообщения.

Философские концепции теории информации

Согласно , существуют шесть основных философских концепций, которые занимаются изучением онтологического и метонимического смыслов понятия информации, как научного понятия, приведенные ниже.

Концепция инфонигилизма отрицает существование информации как сущности. Информация воспринимается как призрак, ошибочное представление науки, как то, что никто никогда не видел, ощущал или фиксировал с помощью какой-либо аппаратуры. В соответствии с этой теорией понятие информации есть пустое множество, поскольку информацию невозможно идентифицировать. Можно привести следующее утверждение М.И. Сетрова, которое ярко иллюстрирует суть этой концепции: «Никто еще не видел ни как субстанцию, ни как свойство эту загадочную информацию <…>. Почему? Да потому, что ее не существует в природе, как не существует флюидов, флогистона, эфира».

В сфере документальных коммуникационных наук к представлению об информации как о чистом вымысле, фикции постепенно пришел пионер социально-информационного подхода А.В. Соколов.

Вторая концепция основана на тезисах, что информация существует, но не в нашем физическом мире. Эта доктрина объясняет природу телепатии, вспышек, привидений и других сверхъестественных явлений, не признаваемых ортодоксальной наукой.

Третья точка зрения касается существования чистой информации без какой-либо формы разновидности. Эти суждения взяты из научных работ К.Э. Циолковского, В.И. Вернадского и А.Д. Сахарова, теологических источников.

Материалистические теории информации

Продолжая перечисление концепций, нельзя не упомянуть об утверждении о том, что информация имеет материальную природу, которая сама по себе очень информативна. С 60-х годов проблема информации привлекла внимание отечественных философов-материалистов, которые не могли примириться с тем, что информация - это идеальная фикция и попытались «материализовать» информацию, найти ей место в материально едином мире. Наиболее авторитетными в философской науке считаются так называемые атрибутивная и функциональная концепции. Обе концепции утверждают, что информация существует в объективной действительности, но расходятся по поводу наличия ее в неживой природе. Первая рассматривает информацию как атрибут, присущий всем уровням материи, то есть превращает информацию в материальный объект, а вторая - как функциональное качество самоуправляемых и самоорганизующихся систем, превращая информацию в функцию. Ниже более подробно рассматривается содержание и основные постулаты этих концепций.

Атрибутивная теория информации

Отражение в материалистической философии понимается как атрибут материи (отсюда - название концепции «атрибутивная»). Связывая отражение и информацию, философы-материалисты превращают информацию в физический феномен, не нарушающий материального единства мира. Однако, объявляя и отражение, и информацию свойствами материи, эта концепция утрачивает критерий разграничения отражательных и информационных явлений. Ниже приводится обоснование этого утверждения.

Об этом свидетельствует отождествление отражения и информации в предлагаемых ими определениях. Так, информация определяется как содержание (сущность) отражения, основная грань (сторона, аспект) отражения, инвариант отражения, отраженное разнообразие, способ существования одной системы через другую. Поскольку сущность заключается в содержании и качественной определенности объекта, то информационные процессы оказываются сущностью отражательных процессов, а отражательные - проявлением информационных.

Таким образом, поскольку информация - сущность отражения, то определения обоих понятий совпадают. Если учесть, что отражение в свою очередь трактуется как содержание (грань, аспект) взаимодействия, то информация оказывается содержанием содержания и гранью граней.

В естественнонаучной концепции информации приобретает характер физического феномена информация. В этой концепции информация ставится в один ряд с категориями вещества и энергии. Эта трактовка воспринята многими научными авторитетами, в том числе А.И. Бергом, В.М. Глушковым, А.П. Ершовым, В.И. Сифоровым. Принципиальное отличие этой концепции от атрибутивной состоит в том, что в ней затруднительно обнаружить взаимосвязь отражения и информации, зато ясно просматривается тенденция к отождествлению информации с организацией.

Функциональная теория информации

Функциональная концепция информации представлена двумя разновидностями: кибернетической и антропоцентристской.

Антропоцентристская концепция, считает областью бытия информации человеческое общество и человеческое сознание.

Кибернетическая концепция утверждает, что информация, и, соответственно, информационные процессы, наличествуют во всех самоуправляемых системах, к которым можно отнести технические, биологические, социальные и многие другие. Функционально-кибернетическая концепция отождествляет информацию с сигналом или структурой.

Приверженцы кибернетической концепции, в свою очередь, подразделяются на две группы. Одну группу образуют практически мыслящие специалисты, которые, определяя информацию как содержание сигнала или сообщения, как обозначение содержания, полученного кибернетической системой из внешнего мира, как означающее нечто воздействие, несущее в себе след какого-то факта или события, отождествляют информацию и сигнал, ибо сигнал не может не иметь значения, а информация не может не иметь материального носителя. Такая трактовка информации вполне оправдывает себя в частных науках, в качестве яркого примера которых можно указать информационную технику. «Сигнал» и «информация» превращаются в синонимы, и можно было бы обойтись одним из них, как поступил, к примеру, И.П. Павлов, говоривший о сигнальных, а не информационных системах.

Другая группа состоит из философствующих кибернетиков, склонных к панинформистскому мировоззрению. Представители этой группы усматривают информацию не только в форме свободно распространяющихся сигналов, но и в форме свойственных материальным объектам структур (связанная, потенциальная, априорная, внутренняя информация). В отличие от свободной (актуальной) информации, информация «связанная» не способна самостоятельно переходить на другие носители; именно она представляет собой то закодированную субстанцию, которую исследователи пытаются извлечь из изучаемого объекта.

Собственно информация остается столь же неопределенной сущностью, что и ранее. Тем не менее с помощью одного неизвестного предпринимаются попытки объяснить другое неизвестное и тем самым разрешить некоторые философские проблемы, например проблему жизни.

Многие авторы философских трудов, являющиеся приверженцами функциональной теории информации, считают информационные процессы органическими качествами живых систем, отличающими их от неживой природы, непременной субстанцией живой материи, психики, сознания. Вот цитаты, наиболее ярко отражающие взгляды представителей этого течения: «Специфика жизни связана с наличием информации, с помощью которой через особого рода регуляцию обеспечивается процесс функционирования системы», «жизнь - это способ существования органических систем, основанный на использовании внутренней информации» .

Информация здесь выступает в качестве универсальной «жизненной силы», управляющей метаболическими процессами в живых существах («информационный метаболизм»), организующей отражение среды и адаптацию к ней, обеспечивающей хранение и передачу наследственных признаков, формирующей популяции, биоценозы, биосферу в целом, и, наконец, определяющей биологическую эволюцию. В отмечается, что, ввиду необоснованности этих теорий, они превращаются в информационную версию витализма.

Панинформистская теория информации

Согласно этой теории, информация является первичной, а материя - вторичной. Президент Международной Академии Информатизации, И.И. Юзвишин, в своих научных работах по теоретической физике, пытается доказать, что информация является главной основой Мира. Он вводит понятие «информацион», который, по его мнению, является главным элементом во Вселенной, дающий жизнь субстанции, порождающий вещество, энергию, пространство, время и т.д. Автор утверждает, что весь мир, в конечном итоге, состоит из информации. Практическое значение теории панинформизма состоит в способности элементов и тканей регенерировать создание продуктов питания, топлива, транспортных средств и т.д. из информации. Так как разные законы действуют на уровень «информационов», и в сравнении с нашим физическим миром, практическое усвоение информации обеспечит возможность избежать препятствий на верхних границах величин, таких как скорость света, абсолютный нуль, преодоление временных отрезков за мгновения, сила гравитации и т.д. Станет возможным повернуть информационные машины в будущее или в прошлое из нашего физического мира, преодолевать пространство с любой скоростью.

Из панинформизма вытекает, что информация в качестве одной из трех основ мироздания, должна служить первопричиной таких свойств материи, как отражение и организация. Значит, отражение нужно объяснять из информации, а не наоборот, как поступают сторонники атрибутивной теории.

Другой крайностью панинформизма является информационный гносеологизм, который объясняет познавательные процессы следующим образом. Так как «всякую комбинацию частиц, веществ или умственных конструкций можно считать кодом какой-либо сущности, следовательно, все, что нас окружает, есть в каком-то смысле информация». Таким образом, познание сводится к декодированию информации, которая «внесена и закреплена» в анатомии животного или в структурах нейрофизиологического характера, в микроскопических или субмикроскопических особенностях клеточного ядра, и вообще во всех познаваемых объектах. При этом ощущение трактуется как результат превращения внешней информации во внутреннюю, материальной - в идеальную. Это позволяет обобщить частные случаи декодирования информации - чувственное и рациональное познание, опыт, интуиция, выявление сущности вещей и событий и многие другие.

Популяризаторы и фантасты не могли обойти своим вниманием панинформизм. Появилось описание страны «Инфория», где информация выращивается на полях, из брикетов информации строятся дома, питаются не хлебом, а информацией, ибо хлеб - не что иное, как «порция информации для желудка, для нервных клеток, для кишечника и в конечном счете - для всего организма». В некотором роде подобные измышления можно считать имеющими право на жизнь, учитывая, однако, что построение подобных идеальных конструкций в реальном мире невозможно.

Стоит отметить высказывания классического шилозиста Жана-Батиста Робине, уверявшего в XVIII веке публику, что алмаз «обладает внутренним сознанием своего превосходства» над другими веществами, золото «знает» о своем «почете» у людей и т. п.

В отмечается, что необоснованность исходных постулатов является основной проблемой в постулатах И.И. Юзвишина.

Информация как субъективная реальность

Согласно этой концепции, информация рассматривается как субъективная реальность. В объективном мире существуют разнообразные свойства и отношения между субстанцией и энергией. Часть их воспринимается нашими органами чувств, распознается, и субъективно воспринимается как информация. Информация рассматривается как семантическая трансформация изображения модели или объективной реальности. Информация реально существует только в представлении субъекта, потому что это - субъективная реальность. Такая концепция объясняет, почему одно и то же сообщение воспринимается различными субъектами по-разному или не воспринимается ими вовсе.

Авторы этой концепции утверждают, что информация в сущности есть достояние только субъективного сознания, за его пределами информации не существует. Онтологически информация есть субъективная реальность. Это утверждение целиком согласуется с достижениями современной психологии.

Информация, ушедшая в глубины сознания, называется памятью. Функция памяти - хранить полученную информацию и возвращать ее в сферу сознания. Память, таким образом, тоже правомерно рассматривать как категорию не только психологическую, но и информационную, приняв определение: «Память - информационная система, непрерывно занятая приемом, видоизменением, хранением и извлечением информации».

Информация, переработанная субъектом, упорядоченная, наложенная на прежние представления и сохраненная, называется знанием. Знание в онтологическом смысле - это тоже исключительно субъективная реальность.

Информация может быть объективирована, например, если она представлена в знаковой форме и перенесена на внешний носитель. В простейшем случае функцию знака выполняет сам изучаемый объект, и тогда мы имеем дело с аутентичным документом. В других обстоятельствах используют искусственные способы записи знаков на естественном или искусственном вещественном или энергетическом носителе.

Аксиологический аспект информации

Одним из ярких представителей прагматических теорий информации является поведенческая модель коммуникации - бихевиористская модель Акоффа-Майлса. Исходным в этой модели является целевая устремленность получателя информации на решение конкретной проблемы. Согласно этой модели, получатель находится в «целеустремленном состоянии», если он стремится к чему-нибудь и имеет альтернативные пути к достижению цели, отличающиеся некоторым образом установленной стоимостью. Сообщение, переданное получателю, информативно, если оно изменяет его «целеустремленное состояние».

Так как такое состояние характеризуется последовательностью возможных действий (альтернатив), энергетическими, временными или другими затратами действия и значимостью результата, то передаваемое получателю сообщение может оказывать воздействие на все три компонента в различной степени. В соответствии с этим передаваемая информация различается по типам на «информирующую», «инструктирующую» и «мотивирующую». Таким образом, для получателя прагматическая ценность сообщения состоит в том, что оно позволяет ему наметить стратегию поведения при достижении цели построением ответов на вопросы: что, как и почему делать на каждом очередном шаге? Для каждого типа информации бихевиористская модель предлагает свою меру, а общая прагматическая ценность информации определяется как функция разности этих количеств между изменениями «целеустремленного состояния"

Следующим этапом в развитии прагматических теорий информации явились работы американского логика Д. Харраха, построившего логико-прагматическую модель коммуникации.

Одной из слабостей бихевиористской модели является ее неподготовленность к оценке ложных сообщений. Модель Харраха предполагает учет общественного характера человеческой коммуникации. В соответствии с ней получаемые сообщения должны быть сначала подвергнуты обработке, после которой выделяются сообщения «годные к употреблению». Именно к совокупности годных к употреблению сообщений должны быть применены критерии прагматической ценности.

По информации не рассматривался смысл (значение) поступающей информации, а в ряде случаев это принципиально, Ю.А. Шрейдер предложил «Семантическую теорию информации».

Так «…результаты анализа или оценки одного и того же произведения литературы или искусства, полученные разными критиками или в разное время, часто не совпадают между собой даже по основным, принципиальным вопросам. Всё это показывает, что восприятие эстетическое не является абсолютным, зависящим лишь от того, что воспринимается, от «информации», заключённой в объекте восприятия, от самого художественного произведения.

Поскольку в процессе восприятия участвует приёмник, воспринимающий эстетическое сообщение, то результаты анализа и оценка сообщения существенно зависят от свойств самого приёмника.

В связи с этим нельзя не сказать о некоторых подходах кибернетики к вопросам эстетического восприятия, которые, в частности, могут способствовать объективной оценке художественного произведения. Естественно, что при такой постановке задачи эти подходы должны учитывать семантическую (смысловую, или содержательную) сторону произведений, а также способность приёмника извлечь из произведения «художественную», эстетическую информацию.

Некоторые аспекты теории информации имеют непосредственное приложение к исследованию восприятия художественных произведений. Так, в последнее время за рубежом и в нашей стране проводятся исследования, связанные с разработкой семантических аспектов теории информации. В общих чертах один из таких аспектов, разрабатываемых Ю. А. Шрейдером , заключается в следующем.

Поскольку информация I, которую получает приёмник из сообщения Т , существенно зависит от свойств самого приемника, вводится в рассмотрение понятие тезауруса θ приёмника.

В словарной практике тезаурусом […] принято называть одноязычный ассоциативный словарь, в котором указаны различные смысловые связи между словами. Тезаурус θ , как и всякий справочник, отражает сведения, накопленные к определённому моменту времени некоторым индивидуумом (приёмником). В частности, он характеризует способность этого индивидуума воспринимать те или другие сообщения.

Информация I , получаемая приёмником, характеризуется как принимаемым сообщением Т , так и степенью изменения тезауруса θ, т. е. I = I (Т, θ).

Иначе говоря, количество информации I (Т, θ), содержащееся в сообщении Т относительно тезауруса θ, характеризуется степенью изменения тезауруса под действием воспринимаемого сообщения.

Очевидно, что из одного и того же сообщения разные приёмники (с разными тезаурусами) извлекают неодинаковую информацию. Вследствие неподготовленности данный тезаурус вообще может не воспринять некоторые (непонятные ему) сообщения. Последние для данного приёмника не несут никакой информации (приемник получил нулевую информацию), и в этом случае его тезаурус не изменился.

Но нулевую информацию приёмник получает также и в случае, если он воспринимает уже известное сообщение. В обоих этих случаях тезаурус приёмника не изменяется и I (Т, θ) = θ .

Таким образом, семантическая теория информации признаёт, что большую роль при восприятии сообщения играет «настройка», «предпрограммирование», подготовленность приёмника.

Поэтому из некоторого данного сообщения примитивный тезаурус информации не извлекает, развитый тезаурус «понимает» сообщение и получает максимальную информацию, а перенасыщенный тезаурус также информации не получает из-за слишком хорошей подготовленности. Так, например, одно и то же «сообщение» - учебник по высшей математике дошкольнику не даёт никакой информации (тезаурус неподготовлен), студенту-математику даёт максимум информации, а профессору-математику опять-таки не даёт никакой информации (тезаурус перенасыщен).

Аналогично и для восприятия художественного произведения (в частности, музыкального) приемник должен обладать некоторым тезаурусом в данном виде искусства. Художественная, или эстетическая, информация, содержащаяся в данном произведении, отлична от нуля лишь для некоторого диапазона тезаурусов…».

Для измерения информации вводятся два параметра: количество информации I и объем данных V д.

Эти параметры имеют разные выражения и интерпретацию в зависимости от рассматриваемой формы адекватности.

Синтаксическая адекватность. Она отображает формально-структурные характеристики информации и не затрагивает ее смыслового содержания. На синтаксическом уровне учитываются тип носителя и способ представления информации, скорость передачи и обработки, размеры кодов представления информации, надежность и точность преобразования этих кодов и т. п.

Информацию, рассматриваемую только с синтаксических позиций, обычно называют данными, так как при этом не имеет значения смысловая сторона.

Семантическая (смысловая) адекватность. Эта форма определяет степень соответствия образа объекта и самого объекта. Семантический аспект предполагает учет смыслового содержания информации. На этом уровне анализируются те сведения, которые отражает информация, рассматриваются смысловые связи. В информатике смысловые связи устанавливаются между кодами представления информации. Эта форма служит для формирования понятий и представлений, выявления смысла, содержания информации и ее обобщения.

Прагматическая (потребительская) адекватность. Она отражает отношение информации и ее потребителя, соответствие информации цели управления, которая на ее основе реализуется. Проявляются прагматические свойства информации только при наличии единства информации (объекта), пользователя и цели управления.

Прагматический аспект рассмотрения связан с ценностью, полезностью использования информации при выработке потребителем решения для достижения своей цели. С этой точки зрения анализируются потребительские свойства информации. Эта форма адекватности непосредственно связана с практическим использованием информации, с соответствием ее целевой функции деятельности системы.

Каждой форме адекватности соответствует своя мера количества информации и объема данных (рис. 2.1).

Рис. 2.1. Меры информации

2.2.1. Синтаксическая мера информации

Синтаксическая мера количества информации оперирует с обезличенной информацией, не выражающей смыслового отношения к объекту.

Объем данных V д в сообщении измеряется количеством символов (разрядов) в этом сообщении. В различных системах счисления один разряд имеет различный вес и соответственно меняется единица измерения данных:

- в двоичной системе счисления единица измерения — бит ( bit — binary digit — двоичный разряд);

- в десятичной системе счисления единица измерения — дит (десятичный разряд).

Пример. Сообщение в двоичной системе в виде восьмиразрядного двоичного кода 10111011 имеет объем данных V д = 8 бит.

Сообщение в десятичной системе в виде шестиразрядного числа 275903 имеет объем данных V д = 6 дит.

Количество информации определяется по формуле:

![]()

где H (α) - энтропия, т.е. количество информации измеряется изменением (уменьшением) неопределенности состояния системы.

Энтропия системы Н (α), имеющая N возможных состояний, согласно формуле Шеннона, равна:

где p i - вероятность того, что система находится в i -м состоянии.

Для случая, когда все состояния системы равновероятны, ее энтропия определяется соотношением

где N - число всевозможных отображаемых состояний;

m - основание системы счисления (разнообразие символов, применяемых в алфавите);

n - число разрядов (символов) в сообщении.

2.2.2. Семантическая мера информации

Для измерения смыслового содержания информации, т.е. ее количества на семантическом уровне, наибольшее признание получила тезаурусная мера, которая связывает семантические свойства информации со способностью пользователя принимать поступившее сообщение. Для этого используется понятие тезаурус пользователя .

Тезаурус — это совокупность сведений, которыми располагает пользователь или система.

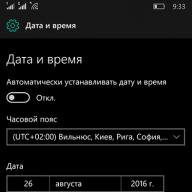

В зависимости от соотношений смыслового содержания информации S и тезауруса пользователя S p изменяется количество семантической информации I с , воспринимаемой пользователем и включаемой им в дальнейшем в свой тезаурус. Характер такой зависимости показан на рис.2.2:

- при S p =0 пользователь не воспринимает, не понимает поступающую информацию;

- при S p → ∞ пользователь все знает, поступающая информация ему не нужна.

Рис. 2.2. Зависимость количества семантической информации, воспринимаемой потребителем, от его тезауруса I с = f (S p )

При оценке семантического (содержательного) аспекта информации необходимо стремиться к согласованию величин S и S p .

Относительной мерой количества семантической информации может служить коэффициент содержательности С , который определяется как отношение количества семантической информации к ее объему:

2.2.3. Прагматическая мера информации

Эта мера определяет полезность информации (ценность) для достижения пользователем поставленной цели. Эта мера также величина относительная, обусловленная особенностями использования информации в той или иной системе. Ценность информации целесообразно измерять в тех же самых единицах (или близких к ним), в которых измеряется целевая функция.

Для сопоставления введенные меры информации представим в табл. 2.1.

Таблица 2.1. Единицы измерения информации и примеры

| Мера информации | Единицы измерения | Примеры (для компьютерной области) |

|---|---|---|

| Синтаксическая: шенноновский подход компьютерный подход |

Степень уменьшения неопределенности | Вероятность события |

| Единицы представления информации | Бит, байт, Кбайт и т.д. | |

| Семантическая | Тезаурус | Пакет прикладных программ, персональный компьютер, компьютерные сети и т.д. |

| Экономические показатели | Рентабельность, производительность, коэффициент амортизации и т.д. | |

| Прагматическая | Ценность использования | Денежное выражение |

| Емкость памяти, производительность компьютера, скорость передачи данных и т.д. | Время обработки информации и принятия решений |

Тема 2. Основы представления и обработки информации в компьютере

Литература

1. Информатика в экономике: Учебное пособие/Под ред. Б.Е. Одинцова, А.Н. Романова. – М.: Вузовский учебник, 2008.

2. Информатика: Базовый курс: Учебное пособие/Под ред. С.В. Симоновича. – СПб.: Питер, 2009.

3. Информатика. Общий курс: Учебник/Соавт.: А.Н. Гуда, М.А. Бутакова, Н.М. Нечитайло, А.В. Чернов; Под общ. ред. В.И. Колесникова. – М.: Дашков и К, 2009.

4. Информатика для экономистов: Учебник/Под ред. Матюшка В.М. - М.: Инфра-М, 2006.

5. Экономическая информатика: Введение в экономический анализ информационных систем.- М.: ИНФРА-М, 2005.

Меры информации (синтаксическая, семантическая, прагматическая)

Для измерения информации могут применяться различные подходы, но наибольшее распространение получили статистический (вероятностный), семантический и прагматический методы.

Статистический (вероятностный) метод измерения информации был разработан К. Шенноном в 1948 году, который предложил количество информации рассматривать как меру неопределенности состояния системы, снимаемой в результате получения информации. Количественно выраженная неопределенность получила название энтропии. Если после получения некоторого сообщения наблюдатель приобрел дополнительную информацию о системе Х, то неопределенность уменьшилась. Дополнительно полученное количество информации определяется как:

где - дополнительное количество информации о системе Х , поступившее в форме сообщения;

Начальная неопределенность (энтропия) системы X ;

Конечная неопределенность (энтропия) системы X, наступившая после получения сообщения.

Если система X может находиться в одном из дискретных состояний, количество которых n , а вероятность нахождения системы в каждом из них равна и сумма вероятностей всех состояний равна единице, то энтропия вычисляется по формуле Шеннона:

где - энтропия системы Х;

а - основание логарифма, определяющее единицу измерения информации;

n – количество состояний (значений), в котором может находится система.

Энтропия величина положительная, а так как вероятности всегда меньше единицы, а их логарифм отрицательный, поэтому знак минус в формуле К.Шеннона делает энтропию положительной. Таким образом, за меру количества информации принимается та же энтропия, но с обратным знаком.

Взаимосвязь информации и энтропии можно понимать следующим образом: получение информации (ее увеличение) одновременно означает уменьшение незнания или информационной неопределенности (энтропии)

Таким образом, статистический подход учитывает вероятность появления сообщений: более информативным считается то сообщение, которое менее вероятно, т.е. менее всего ожидалось. Количество информации достигает максимального значения, если события равновероятны.

Р. Хартли предложил следующую формулу для измерения информации:

I=log2n ,

где n - количество равновероятных событий;

I – мера информации в сообщении о наступлении одного из n событий

Измерение информации выражается в ее объёме. Чаще всего это касается объёма компьютерной памяти и объёма данных, передаваемых по каналам связи. За единицу принято такое количество информации, при котором неопределённость уменьшается в два раза, такая единица информации получила название бит .

Если в качестве основания логарифма в формуле Хартли используется натуральный логарифм (), то единицей измерения информации является нат (1 бит = ln2 ≈ 0,693 нат). Если в качестве основания логарифма используется число 3, то - трит , если 10, то - дит (хартли).

На практике чаще применяется более крупная единица - байт (byte ), равный восьми битам. Такая единица выбрана потому, что с ее помощью можно закодировать любой из 256 символов алфавита клавиатуры компьютера (256=28).

Кроме байтов информация измеряется полусловами (2 байта), словами (4 байта) и двойными словами (8 байт). Широко используются также еще более крупные единицы измерения информации:

1 Килобайт (Кбайт - kilobyte ) = 1024 байт = 210 байт,

1 Мегабайт (Мбайт - megabyte ) = 1024 Кбайт = 220 байт,

1 Гигабайт (Гбайт - gigabyte ) = 1024 Мбайт = 230 байт.

1 Терабайт (Тбайт - terabyte ) = 1024 Гбайт = 240 байт,

1 Петабайт (Пбайт - petabyte ) = 1024 Тбайт = 250 байт.

В 1980 году российский математик Ю. Манин предложил идею построения квантового компьютера, в связи с чем появилась такая единица информации как кубит (quantum bit, qubit) – «квантовый бит» – мера измерения объема памяти в теоретически возможном виде компьютера, использующем квантовые носители, например - спины электронов. Кубит может принимать не два различных значения («0» и «1»), а несколько, соответствующих нормированным комбинациям двух основных состояний спина, что дает большее число возможных сочетаний. Так, 32 кубита могут закодировать около 4 млрд состояний.

Семантический подход. Синтаксической меры не достаточно, если требуется определить не объем данных, а количество нужной в сообщении информации. В этом случае рассматривается семантический аспект, позволяющий определить содержательную сторону сведений.

Для измерения смыслового содержания информации можно воспользоваться тезаурусом ее получателя (потребителя). Идея тезаурусного метода была предложена Н. Винером и развита нашим отечественным ученым А.Ю. Шрейдером.

Тезаурусом называется совокупность сведений , которыми располагает получатель информации. Соотнесение тезауруса с содержанием поступившего сообщения позволяет выяснить, насколько оно снижает неопределенность..

Зависимость объема смысловой информации сообщения от тезауруса получателя

Согласно зависимости, представленной на графике, при отсутствии у пользователя какого-либо тезауруса (знаний о существе поступившего сообщении, то есть =0), или наличия такого тезауруса, который не изменился в результате поступления сообщения (), то объем семантической информации в нем равен нулю. Оптимальным будет такой тезаурус (), при котором объем семантической информации будет максимальным (). Например, семантической информации в поступившем сообщении на незнакомом иностранном языке будет ноль , но и такая же ситуация будет в том случае, если сообщение уже не является новостью, так как пользователю уже все известно.

Прагматическая мера информации определяет ее полезность в достижении потребителем своих целей. Для этого достаточно определить вероятность достижения цели до, и после получения сообщения и сравнить их. Ценность информации (по А.А. Харкевичу) рассчитывается по формуле:

где - вероятность достижения цели до получения сообщения;

Вероятность достижения цели поле получения сообщения;